您所在的位置:首页 - Linux - 正文Linux

Nginx反爬虫攻略:禁止某些User Agent抓取网站

萧何-Vincent

2022-01-26

【Linux】

2473人已围观

萧何-Vincent

2022-01-26

【Linux】

2473人已围观

我们都知道网络上的爬虫非常多,有对网站收录有益的,比如百度蜘蛛(Baiduspider),也有不但不遵守robots规则对服务器造成压力,还不能为网站带来流量的无用爬虫,比如宜搜蜘蛛(YisouSpider)(最新补充:宜搜蜘蛛已被UC神马搜索收购!所以本文已去掉宜搜蜘蛛的禁封!==>相关文章)。最近发现nginx日志中出现了好多宜搜等垃圾的抓取记录,于是整理收集了网络上各种禁止垃圾蜘蛛爬站的方法,在给自己网做设置的同时,也给各位站长提供参考。

#禁止Scrapy等工具的抓取

if ($http_user_agent ~* (Scrapy|Curl|HttpClient)) {

return 403;

}

#禁止指定UA及UA为空的访问

if ($http_user_agent ~ "WinHttp|WebZIP|FetchURL|node-superagent|java/|FeedDemon|Jullo|JikeSpider|Indy Library|Alexa Toolbar|AskTbFXTV|AhrefsBot|CrawlDaddy|Java|Feedly|Apache-HttpAsyncClient|UniversalFeedParser|ApacheBench|Microsoft URL Control|Swiftbot|ZmEu|oBot|jaunty|Python-urllib|lightDeckReports Bot|YYSpider|DigExt|HttpClient|MJ12bot|heritrix|EasouSpider|Ezooms|BOT/0.1|YandexBot|FlightDeckReports|Linguee Bot|^$" ) {

return 403;

}

#禁止非GET|HEAD|POST方式的抓取

if ($request_method !~ ^(GET|HEAD|POST)$) {

return 403;

}

然后,在网站相关配置中的 server段插入如下代码:

附录:UA收集

FeedDemon 内容采集 BOT/0.1 (BOT for JCE) sql注入 CrawlDaddy sql注入 Java 内容采集 Jullo 内容采集 Feedly 内容采集 UniversalFeedParser 内容采集 ApacheBench cc攻击器 Swiftbot 无用爬虫 YandexBot 无用爬虫 AhrefsBot 无用爬虫 YisouSpider 无用爬虫(已被UC神马搜索收购,此蜘蛛可以放开!) jikeSpider 无用爬虫 MJ12bot 无用爬虫 ZmEu phpmyadmin 漏洞扫描 WinHttp 采集cc攻击 EasouSpider 无用爬虫 HttpClient tcp攻击 Microsoft URL Control 扫描 YYSpider 无用爬虫 jaunty wordpress爆破扫描器 oBot 无用爬虫 Python-urllib 内容采集 Indy Library 扫描 FlightDeckReports Bot 无用爬虫 Linguee Bot 无用爬虫

Tags: Linux

文章评论 (暂无评论,2473人围观)

站长推荐

思科、华为、H3C命令对照表

-

小程序实战:从入门到上线,手把手教你搭建天气预报微信小程序

PHP | 2022-07-05

-

【php算法】有一母牛,到4岁可生育,每年一头,所生均是一样的母牛...问n年后有多少头牛?

PHP | 2022-07-05

-

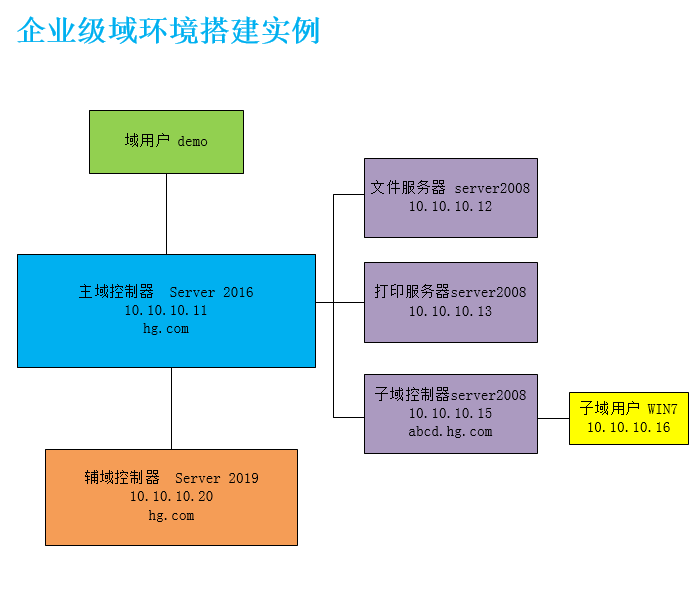

企业级域环境搭建实例——主域,辅域和子域,DNS配置实例

Network | 2022-07-01

-

MySQL + JSON = 王炸!!

DataBase | 2022-03-03

-

LVS(Linux虚拟服务)----服务器集群系统工作原理

Linux | 2022-03-01

-

元宇宙的来源是什么?涉及核心技术BIGANT

AI, Big Data | 2022-02-22

-

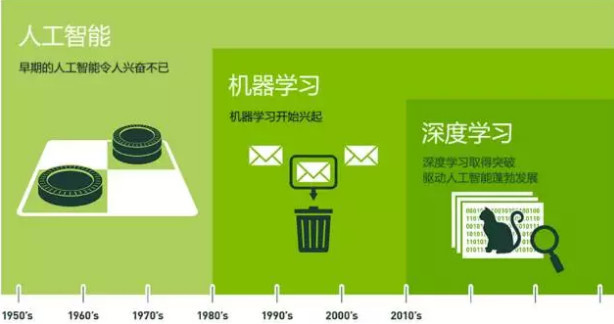

人工智能(Artificial Intelligence)、机器学习(Machine Learning)、深度学习(Deep Learning)三者区别

AI, Big Data | 2022-01-06

-

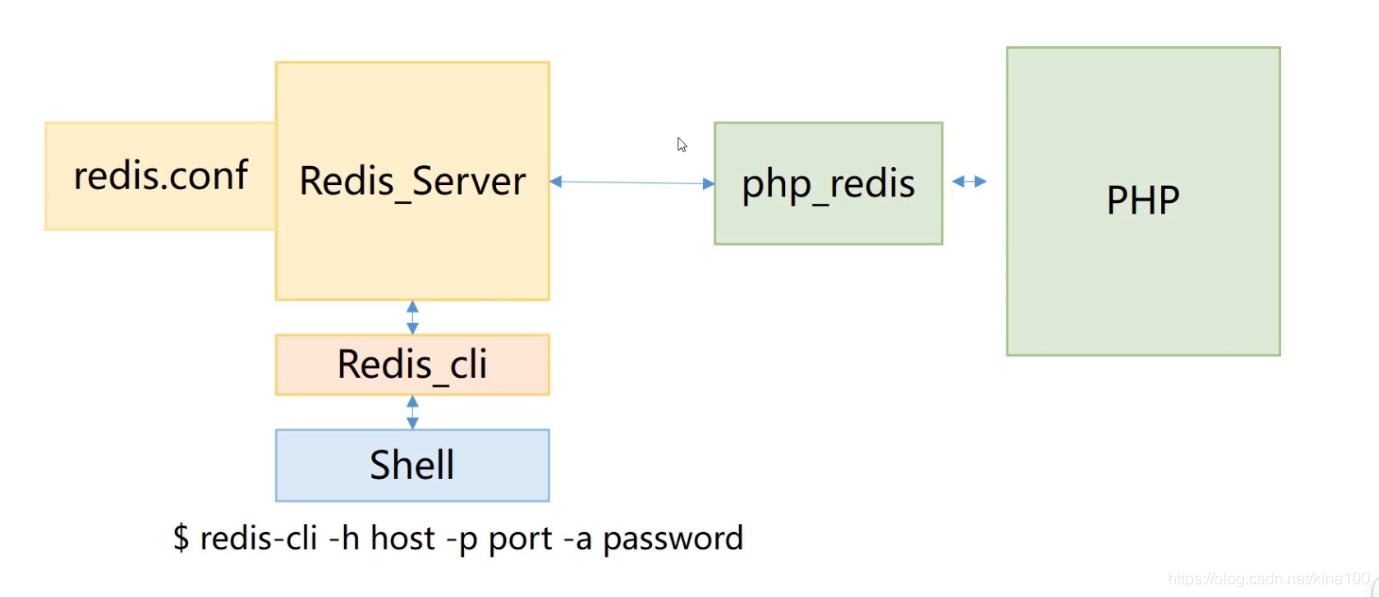

Redis 学习知识小记

DataBase | 2021-11-04

-

php面试常规问题主键索引和唯一索引有什么区别

DataBase | 2021-11-04

最新留言

-

世界末日我都挺过去了,看到楼主我才知道为什么上帝留我到现在!http://1r8.pistpyh.cn/

昵称:访客2024-07-04

-

这位作者的文笔极其出色,用词精准、贴切,能够形象地传达出他的思想和情感。http://oui.kblewwq.cn/

昵称:访客2024-07-04

-

坚持回帖!http://mqp.baishanct.com/

昵称:访客2024-07-04

-

在哪里跌倒,就在那里多爬一会儿!http://gx.baishanct.com/

昵称:访客2024-07-04

-

好东西,学习学习!http://mn7jf.xmona.com.cn/

昵称:访客2024-07-04

-

这么好的帖子,应该加精华!http://www.baishanct.com/

昵称:访客2024-07-04

-

昵称:微信用户2023-12-28

-

昵称:mm2023-12-12

-

昵称:微信用户2023-11-25

-

昵称:Tim2022-07-28

站点信息

- 文章总数:65

- 页面总数:1

- 分类总数:5

- 标签总数:12

- 评论总数:24

- 浏览总数:82970